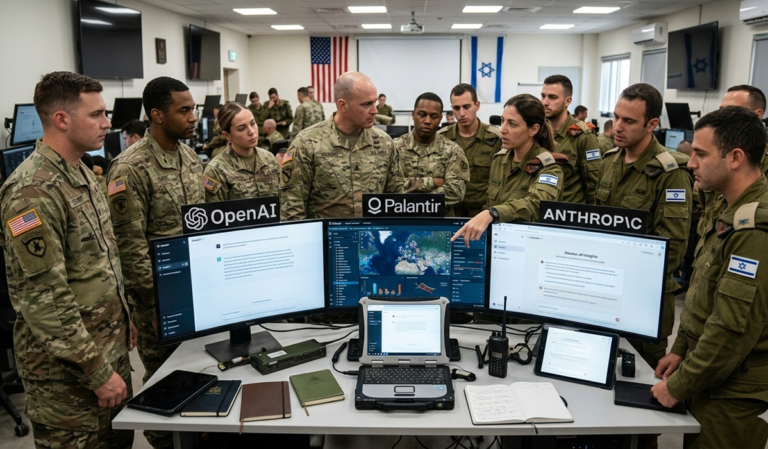

Penggunaan teknologi kecerdasan buatan (AI) dalam konflik militer semakin meningkat, terutama di kawasan Timur Tengah. Militer Amerika Serikat dan Israel telah memanfaatkan berbagai sistem AI untuk berbagai tujuan, termasuk analisis data intelijen, pemilihan target, dan simulasi medan perang. Salah satu contoh yang menonjol adalah penggunaan model AI bernama Claude dari perusahaan Anthropic oleh militer AS. Teknologi ini digunakan untuk menganalisis data intelijen dalam jumlah besar, serta membantu dalam proses pengambilan keputusan strategis.

Penggunaan AI dalam Perang di Iran

Dalam serangan terhadap Iran, militer AS dan Israel melakukan hampir 900 serangan hanya dalam 12 jam pertama. Rudal Israel berhasil menewaskan Ayatollah Ali Khamenei, pemimpin tertinggi Iran. Komando militer AS menyatakan bahwa mereka menggunakan alat berbasis AI dari Anthropic untuk menganalisis data intelijen secara efisien dan memilih target dengan akurat. Pada 2024, model AI dari Anthropic diterapkan di Departemen Perang AS dan lembaga keamanan nasional lainnya untuk mempercepat perencanaan perang. Claude menjadi bagian dari sistem yang dikembangkan oleh Palantir Technologies bersama Pentagon, yang bertujuan meningkatkan analisis intelijen dan memperkuat proses pengambilan keputusan.

Palantir Technologies adalah perusahaan perangkat lunak analitik big data yang fokus pada penyediaan platform terintegrasi untuk organisasi kompleks, intelijen pemerintah, dan sektor komersial. Sistem AI terbaru dari Palantir dapat menganalisis informasi tentang target potensial, mulai dari rekaman drone hingga intersepsi telekomunikasi dan intelijen manusia. Sistem ini juga menggunakan pembelajaran mesin untuk mengidentifikasi dan memprioritaskan target, merekomendasikan persenjataan, serta mengevaluasi dasar hukum untuk melakukan serangan.

Perselisihan Antara Anthropic dan Pemerintah AS

Namun, pada Januari 2026, Anthropic berselisih dengan Pemerintah AS. Perusahaan keberatan dengan penggunaan Claude AI oleh militer AS dalam serangan untuk menangkap Presiden Venezuela, Nicolás Maduro. Anthropic menyatakan bahwa ketentuan penggunaan jelas menyebutkan bahwa Claude tidak boleh digunakan untuk tujuan kekerasan, pengembangan senjata, atau pengawasan. Pada Jumat (27/2), Presiden AS Donald Trump memerintahkan semua lembaga federal untuk segera berhenti menggunakan Claude. Dia juga mengecam Anthropic di media sosial miliknya Truth Social. Meskipun demikian, militer AS masih menggunakan Claude AI selama enam bulan ke depan, untuk masa transisi beralih ke ChatGPT buatan OpenAI.

Dampak AI pada Proses Pengambilan Keputusan Militer

Para akademisi mengatakan bahwa AI mempersingkat waktu perencanaan yang dibutuhkan untuk serangan kompleks, fenomena yang dikenal sebagai ‘kompresi keputusan’. Hal ini dikhawatirkan dapat mengakibatkan para ahli militer dan hukum manusia hanya sekadar menyetujui rencana serangan otomatis. Menurut Craig Jones, dosen senior geografi politik di Universitas Newcastle, AI memberikan rekomendasi cepat tentang apa yang harus ditargetkan, yang lebih cepat daripada kecepatan berpikir manusia. Dengan demikian, serangan dapat dilakukan dalam waktu singkat, melumpuhkan kemampuan rezim untuk merespons.

Microsoft dan OpenAI dalam Konflik Gaza

Selain itu, Microsoft dan OpenAI diduga membantu Israel dalam serangan ke Gaza. Investigasi Associated Press pada awal 2025 mengungkapkan bahwa raksasa teknologi AS memasok model AI ke Israel selama serangan di Gaza dan Lebanon. Militer Israel menggunakan AI untuk menyaring sejumlah besar intelijen, komunikasi yang dicegat, dan pengawasan untuk menemukan ucapan atau perilaku yang mencurigakan dan mempelajari pergerakan musuh-musuhnya.

Penggunaan Azure dan OpenAI oleh Militer Israel

Militer Israel menggunakan Microsoft Azure untuk mengumpulkan informasi yang diperoleh melalui pengawasan massal, termasuk panggilan telepon, pesan teks, dan pesan audio. Data tersebut kemudian dicocokkan dengan sistem penargetan internal Israel, seperti Lavender. Model AI canggih disediakan melalui OpenAI, pembuat ChatGPT, melalui platform cloud Azure milik Microsoft. Meskipun OpenAI mengklaim tidak memiliki kemitraan dengan militer Israel, kebijakan penggunaannya mengizinkan ‘kasus penggunaan keamanan nasional yang selaras dengan misi perusahaan’.

Risiko dan Pertanyaan Etis

OpenAI mengakui bahwa model terjemahan AI mereka, Whisper, dapat mengarang teks yang tidak pernah diucapkan siapa pun, termasuk menambahkan komentar rasis dan retorika kekerasan. Para perwira militer Israel mengakui bahwa kesalahan dapat terjadi karena banyak alasan yang melibatkan AI. Selain itu, sumber-sumber intelijen mengklaim bahwa pejabat militer Israel mengizinkan sejumlah besar warga sipil Palestina untuk dibunuh. Lavender AI, yang dikembangkan oleh Unit 8200 Israel, memproses data untuk mengidentifikasi calon agen ‘junior’ yang akan menjadi target.

Masa Depan Perang dengan AI

Perkembangan ini menandai babak baru peperangan modern, ketika algoritma dan komputasi awan menjadi bagian dari rantai keputusan militer. Di satu sisi, teknologi kecerdasan buatan meningkatkan kecepatan, akurasi, dan efisiensi operasi. Namun di sisi lain, penggunaan AI dalam konflik bersenjata memunculkan pertanyaan serius soal akuntabilitas, transparansi, serta perlindungan warga sipil. Ketika keputusan menyerang dapat dipercepat dalam hitungan menit oleh sistem otomatis, perdebatan etis dan hukum tentang peran manusia dalam menentukan hidup dan mati pun semakin mendesak.